LLM

Générez et transformez du texte avec des modèles de langage puissants

À quoi sert ce node ?

Le node LLM (Large Language Model) permet de générer, transformer et analyser du texte à l’aide de modèles IA comme GPT, Claude ou Gemini. C’est la base des workflows pilotés par l’IA.

Usages courants :

- Générer du contenu (articles, résumés, e-mails)

- Analyser et extraire des informations

- Transformer des formats de texte

- Répondre à des questions sur des données

Configuration rapide

Ajouter le node LLM

Trouvez-le dans la bibliothèque de nodes sous AI Nodes → LLM

Rédiger vos instructions

Indiquez à l’IA ce qu’elle doit faire. Soyez précis et clair.

Choisir un modèle

Sélectionnez parmi GPT, Claude, Gemini, etc.

Connecter et exécuter

Connectez les entrées et lancez votre workflow

Configuration

Champs obligatoires

instructions string required Le prompt qui indique à l’IA quoi faire. C’est le champ le plus important.

Conseils pour de bonnes instructions :

- Soyez précis sur ce que vous voulez

- Donnez du contexte et des exemples

- Précisez le format de sortie

- Utilisez des variables pour inclure des données dynamiques

Exemple :

Résume l’article suivant en 3 points.

Insiste sur les principaux enseignements pour les marketeurs.

Article :

{{content}}Champs optionnels

system_message string Définit la persona et le contexte de comportement de l’IA.

Exemple :

Vous êtes un consultant SEO senior. Donnez des recommandations

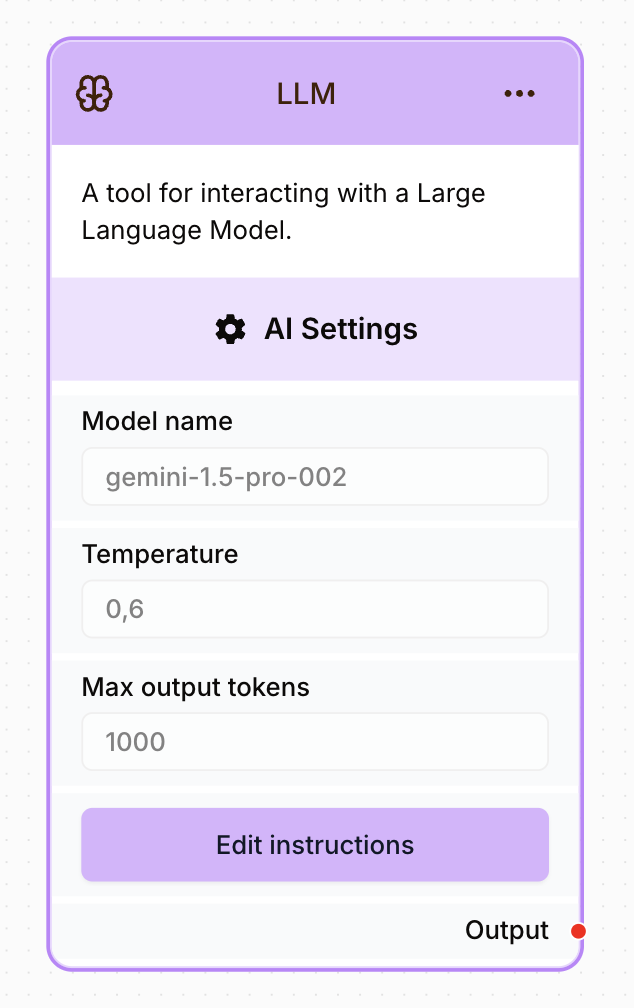

concrètes et actionnables basées sur les données.Paramètres IA

model string default: gpt-4o Le modèle IA à utiliser.

| Modèle | Idéal pour | Vitesse | Coût |

|---|---|---|---|

| GPT | Tâches complexes, raisonnement | Moyenne | Élevé |

| Claude | Contenu long, nuance | Moyenne | Moyen |

| Gemini | Intégration Google | Rapide | Moyen |

temperature number default: 0.6 Contrôle le caractère aléatoire de la sortie.

| Valeur | Comportement |

|---|---|

| 0,0–0,3 | Concentré, cohérent |

| 0,4–0,6 | Équilibré (par défaut) |

| 0,7–1,0 | Créatif, varié |

max_output_tokens number default: 1000 Longueur maximale de la réponse en tokens.

- 500 tokens ≈ 375 mots

- 1000 tokens ≈ 750 mots

- 4000 tokens ≈ 3000 mots

output_json_schema object Définir un schéma JSON pour obtenir une sortie structurée.

Exemple :

{

"summary": "string",

"score": "number",

"recommendations": ["string"]

}Sortie

Le node renvoie la réponse de l’IA :

{

"response": "Le texte généré ou la sortie JSON...",

"model": "gpt-4o",

"tokens_used": 523,

"finish_reason": "stop"

}Accéder à la réponse : {{LLM_0.response}}

Exemples

Résumé de contenu

Instructions :

Résume cet article en 3 points :

{{content}}

Garde chaque point sous 20 mots.Sortie :

• Les outils IA transforment les workflows de contenu

• L’automatisation fait gagner 10+ heures par semaine

• L’intégration aux outils existants est fluideExtraction de données

Instructions :

Extrais les informations suivantes de cette page entreprise :

{{content}}

Retourne en JSON :

{

"company_name": "",

"industry": "",

"employee_count": "",

"products": []

}Sortie :

{

"company_name": "Acme Technologies",

"industry": "SaaS",

"employee_count": "50-100",

"products": ["Project Management", "Time Tracking"]

}Génération de contenu

Instructions :

Écris un e-mail professionnel à {{contact_name}} chez {{company}}.

Contexte : {{meeting_notes}}

L’e-mail doit :

- Les remercier pour la réunion

- Résumer les points clés discutés

- Proposer les prochaines étapes

- Faire moins de 150 motsBonnes pratiques

Rédiger des prompts efficaces

Résume cet article en exactement 3 points.

Chaque point doit faire moins de 20 mots.

Insiste sur les enseignements actionnables pour les marketeurs.

Article :

{{content}}Résume ça :

{{content}}Utiliser les messages système

Définir le contexte pour de meilleurs résultats :

Système : Vous êtes un analyste de données. Donnez toujours des chiffres

précis et citez vos sources. Utilisez un ton professionnel.Demander une sortie structurée

Pour un traitement dans les nodes suivants, demandez du JSON :

Analyse ces données et retourne en JSON :

{

"sentiment": "positive|negative|neutral",

"confidence": 0-100,

"key_phrases": ["...", "..."]

}Gérer le contenu long

Pour un contenu qui peut dépasser la limite de tokens :

- Découper le contenu avant envoi

- Traiter les morceaux séparément

- Fusionner les résultats

Problèmes courants

La réponse est coupée

Augmentez max_output_tokens. La valeur par défaut peut être trop basse pour les sorties longues.

La sortie JSON est invalide

- Utilisez un schéma JSON dans les paramètres

- Ajoutez « Retourne uniquement du JSON valide » dans les instructions

- Baissez la température pour un formatage plus cohérent

Les résultats sont trop aléatoires

Baissez la température (0,2–0,4) pour des sorties plus cohérentes.

La réponse ne suit pas les instructions

- Soyez plus précis dans vos instructions

- Ajoutez des exemples de sortie attendue

- Utilisez un message système pour définir le contexte